基于数字集成电路的智能监控与识别追踪系统*

*本项目获得“2020全国大学生集成电路创新创业大赛”全国三等奖,西南赛区一等奖

本文引用地址://m.amcfsurvey.com/article/202104/424912.htm作者简介:张健(1999—),男,汉,主要从事机器视觉,图像处理,FPGA,RISC-V等方面的研究。

牛丽婷(2000—),女。王宜楠(1999—),女。

0 引言

近年来,随着数字电子技术的不断发展进步,基于图像处理的自动监控技术逐渐走进大家的视野,公众的安全与社会的稳定由此受到一定的保障。传统的视频监控系统主要是通过一些传感器来采集数据,但需要有操作员长时间观察显示器,并通过人脑的判断来对其进行相应识别,十分耗费精力。因此,引入智能监控与识别追踪技术十分有必要。本设计应用移动侦测,一旦采集得的图像数据中移动程度超过了检测阈值,且判断移动的物体是人而不是动物,系统即自动发出报警及时通知监测人员,并实现摄像头的跟随移动监控,从而大程度提高监测效率。

1 整体构架

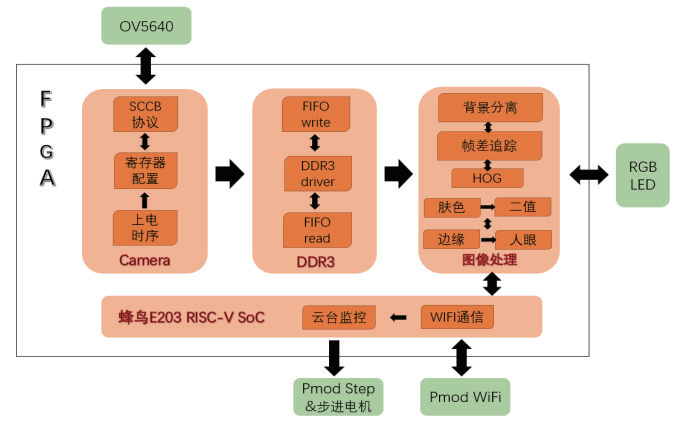

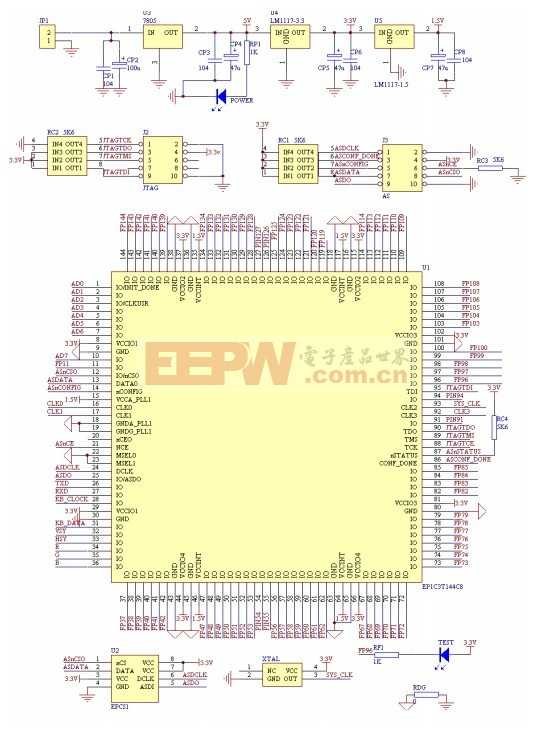

本团队所设计的机器人的整体架构设计框图如图1所示。由图可见,系统分为相互联系的摄像头模块、DDR3 SDRAM 数据存储与通信模块、图像处理模块以及蜂鸟 E203 RISC-V SoC 片上系统。

图1 系统整体架构设计图

2 算法系统

2.1背景差分法

2.1.1 原理介绍

背景差分法是先设定一张图像作为背景图像,然后通过对比背景图像和接下来每一帧图像数据的关系,设阈值做差分来分离出运动目标轮廓的一种方法。背景差分法是当前被广泛采用的一种动态目标检测方法。使用背景差分法检测运动物体首先需要建立背景模板M(x,y),预先储存一帧图像画面作为背景图像,然后接下来采集到的每一帧图像T(x,y) 要与背景模板M(x,y)进行减法运算,在设定一个合适的阈值P 的前提下,减出来的数值如果在阈值之内,则说明画面静止;如果超出了阈值,则表示这个像素点是运动目标的其中一个点,将两种结果进行二值化,最终结果设为B(x,y)。[1]

背景差分法实现的关键是背景模型的获取和更新。背景获取算法通常要求在场景中存在运动目标的情况下获取背景图像,更新过程使背景能够适应场景的各种变化和干扰, 如外界光线的改变, 背景中对象的扰动和固定对象的移动,阴影的影响等。一种典型的背景建模方法是用混合高斯模型描述背景图像像素值的分布,目标检测过程中判断图像的当前像素值是否符合该分布,若是被判为前景点,否则为背景点。同时根据新获取的图像,对背景图像参数进行自适应更新。

在本设计中,我们将背景差分法与下文介绍的帧差法相结合,避免光照变化等情况对运动目标的漏检和误检,获得系统检测的鲁棒性。

2.1.2 算法实现

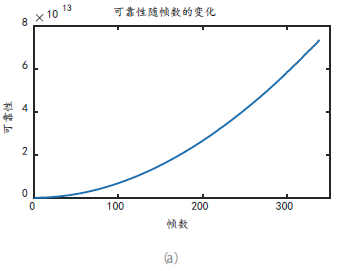

在利用背景差分法来实现对运动区域的检测时,需要通过连续k 帧的区域反馈识别物体的移动。本设计通过对实际图像建模建立背景模板,将获取的图像数据与之比较,取约1 000 个不同时刻的像素值与原有数据求平均值,从而求出k 的最优解,即k 为多少时,能够较好地吻合数据波动,并使k 尽可能地小,从而能确定取连续多少张背景图时,能最迅速且最高效地实现背景差分法检测运动物体(如图2)。

备注:算法所指平均值为“实时平均值” avertime算术平均值称为“真实平均值” averreal

图 a:可靠性reliability = (aver − aver ) time real2 Design & Application 工业控制

图b:分别将表格第4 列和第5 列画出,可直观感受到对比

图c:将第4、5 列作差得到测量误差随帧数的变化

图 d:波动性volatility = probe2 − avertime

2.1.3. 处理环境波动

对于一个相对安静的场景,我们将诸如光线明暗变化和风吹叶动称为环境的固有波动,属于环境的固有属性。而对于500 万像素的OV5640 拍摄出来的图像,像素点的小范围波动称为硬件波动。在处理一个运动场景,要想分离出有效的运动目标,就要克服环境固有波动和硬件波动。[2]

本设计充分统计了这两种不可消除的波动分布,大致分为四个场景:光线明亮、光线昏暗、颜色多杂和纯色背景。对于这四种不同场景,我们选取的阈值是不同的,充分提高监控设备的运动侦测敏感度的同时,尽量做到不误报。

2.2 HOG特征提取算法

2.2.1. HOG特征原理介绍

方向梯度直方图(Histogram of Oriented Gradient,HOG)特征是一种在计算机视觉和图像处理中用来进行物体检测的特征描述子。它通过计算和统计图像局部区域的梯度方向直方图来构成特征。Hog 特征结合SVM 分类器已经被广泛应用于图像识别中,尤其在行人检测中获得了极大的成功。[3]

1) 主要思想

在一副图像中,局部目标的表象和形状(appearance and shape)能够被梯度或边缘的方向密度分布很好地描述。(本质:梯度的统计信息,而梯度主要存在于边缘的地方)。

2) 具体的实现方法:

首先将图像分成小的连通区域,我们把它叫细胞单元。然后采集细胞单元中各像素点的梯度的或边缘的方向直方图。最后把这些直方图组合起来就可以构成特征描述器。

3) 提高性能:

把这些局部直方图在图像的更大的范围内(我们把它叫区间或block) 进行对比度归一化(contrastnormalized),所采用的方法是:先计算各直方图在这个区间(block)中的密度,然后根据这个密度对区间中的各个细胞单元做归一化。通过这个归一化后,能对光照变化和阴影获得更好的效果。[4]

2.2.2 HOG特征提取算法的实现过程

HOG 特征提取方法就是将一个image(你要检测的目标或者扫描窗口):

1) 灰度化(将图像看做一个x,y,z(灰度)的三维图像);

2) 采用Gamma 校正法对输入图像进行颜色空间的标准化(归一化);目的是调节图像的对比度,降低图像局部的阴影和光照变化所造成的影响,同时可以抑制噪声的干扰;

3) 计算图像每个像素的梯度(包括大小和方向);主要是为了捕获轮廓信息,同时进一步弱化光照的干扰。

4) 将图像划分成小cells(例如6×6 像素/cell);

5) 统计每个cell 的梯度直方图(不同梯度的个数),即可形成每个cell 的descriptor;

6) 将每几个cell 组成一个block(例如3*3 个cell/block),一个block 内所有cell 的特征descriptor 串联起来便得到该block 的HOG 特征descriptor。

7) 将图像image 内的所有block 的HOG特征descriptor串联起来就可以得到该image(你要检测的目标)的HOG 特征descriptor 了。这个就是最终的可供分类使用的特征向量了。

2.3 人眼检测

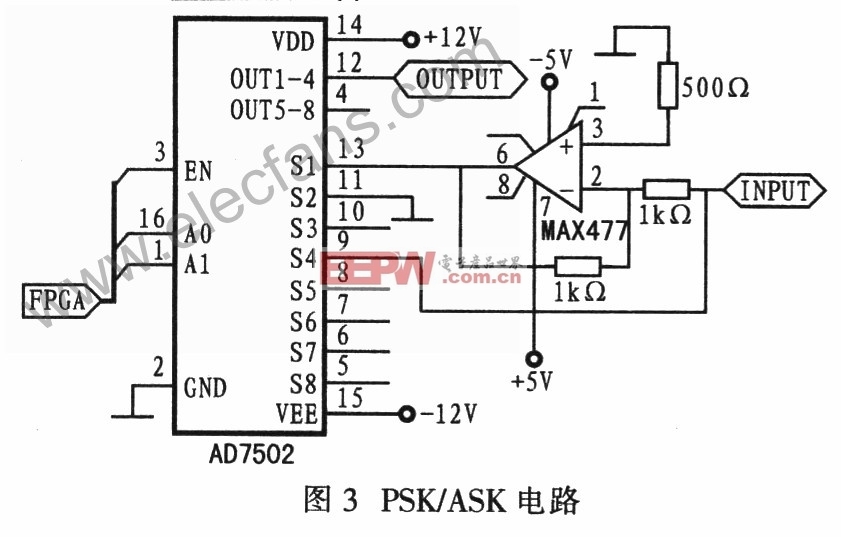

2.3.1 原理介绍

通过对输入图像矩阵的处理,标记出人脸位置和眼睛的位置。

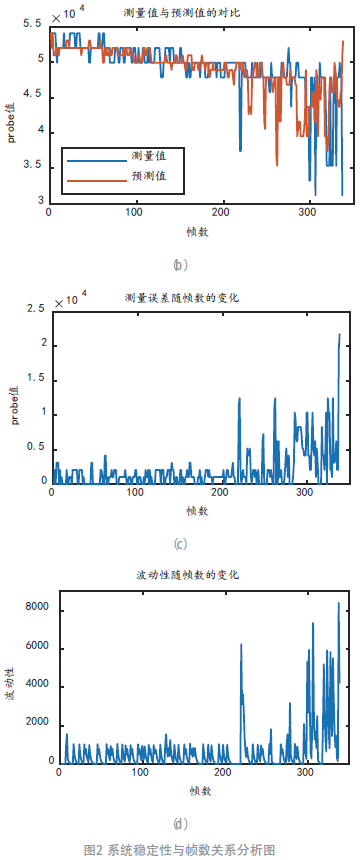

利用人脸几何特征和sobel 边缘检测算法,对在有背景的灰度和彩色人脸图像中自动检测与定位人眼的操作。通过读取输入的图片并将其存储在RGB 矩阵内,接着对图片人脸区域进行识别;然后采用sobel 算法对人脸区域进行边缘提取,并在存储边缘轮廓的矩阵中结合脸部边缘特征定位眼睛。

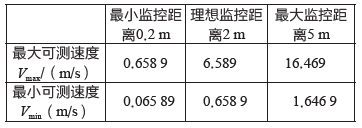

具体步骤如图3。

图3 人眼检测部分功能框图

2.3.2 程序设计

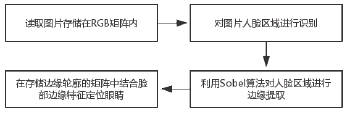

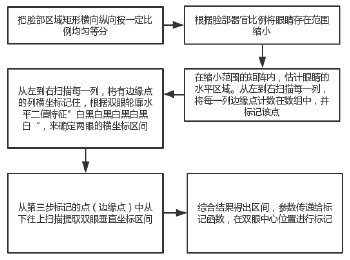

具体步骤如图4。

图4 眼部定位步骤流程

3 机械结构

3.1 摄像头

OV5640 摄像头主要由镜头、图像传感器、板载电路及下方的信号引脚组成。镜头部件包含一个镜头座和一个可旋转调节距离的凸透镜,通过旋转可以调节焦距,正常使用时,镜头座覆盖在电路板上遮光,光线只能经过镜头传输到正中央的图像传感器,它采集光线信号,然后把采集得到的数据通过下方的信号引脚输出数据到外部器件。

3.2 WiFi

3.2.1 功能

实现实时WiFi 信息传输,为实现未带口罩示警提供技术支撑。

3.2.2 特点

提供用户按钮,用于在模式切换后重置处理器。提供WiFi、低功耗蓝牙和蓝牙通信。

3.3 云台监控

Pmod Step 板驱动步进电机,带动摄像头延长板底座随之转动,从而实现摄像头的全方位跟随监控。

4 系统整合报告

4.1 鲁棒性

本团队着手从反应速度、视野范围和移动目标漏检率等指标来衡量一个监控检测入侵系统的性能优劣,并得出以下结论

4.1.1 监控设备反应速度较快

机器人采用OV5640 摄像头,并使用Verilog 配置1 024×768 分辨率,像素时钟pclk 为84 MHz,可计算出视频帧率为65 Hz。

为消除环境波动给背景分离过程带来的影响,我们取16 帧图像为一次处理过程,计算出平均波动值并和阈值比较。因此,机器人处理一次环境波动所需时间 ,约为0.25 s,远低于市面上的智能监控设备。

,约为0.25 s,远低于市面上的智能监控设备。

4.1.2 视野范围广

此机器人所用OV5640 摄像头监控角度大约为44.096 ° ( 误差不超过5 °), 推荐可监控的直径为0.2~5 m,理想距离为2 m。不难计算,机器人的视野范围为0.162 2~4.054 m,理想距离下的视野宽度为1.622 m。在这样较开阔的视野下,能有效保证监控到室内的每个角落,并能有良好的监控效果。

4.1.3 移动目标可监控范围大

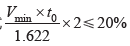

移动目标漏检指标,是用来表征监控设备对高速和低速运动物体检测能力。理想距离(2 m)下目标以速度Vmax 快速横向穿过监控视野(1.622 m),所用时低于反应速度即不被机器人捕捉到,可计算得机器人在理想监控距离下的最大检测速度Vmax=6.589 m/s。设静止环境波动值为M0,则机器人所设阈值为120% M0。此时目标以速度Vmin 缓慢在监控视野内横向移动,若目标移动导致的环境波动低于阈值,则可不被监控识别到。此时速度应满足不等式 ,可计算出机器

,可计算出机器

人在理想监控距离下的最小检测速度Vmin=0.658 9 m/s。同理可得最小和最大监控距离下的理论目标速度范围,如表1。

表1 最小和最大监控距离下的理论目标速度

经实际测量,上述理论分析值可靠可信。由此可得,本机器人适用于绝大多数室内监控入侵场景,可检测范围囊括了全部目标可能移动速度,可以基本做到在较极端场景下的不漏检,即有较高的性能鲁棒性。

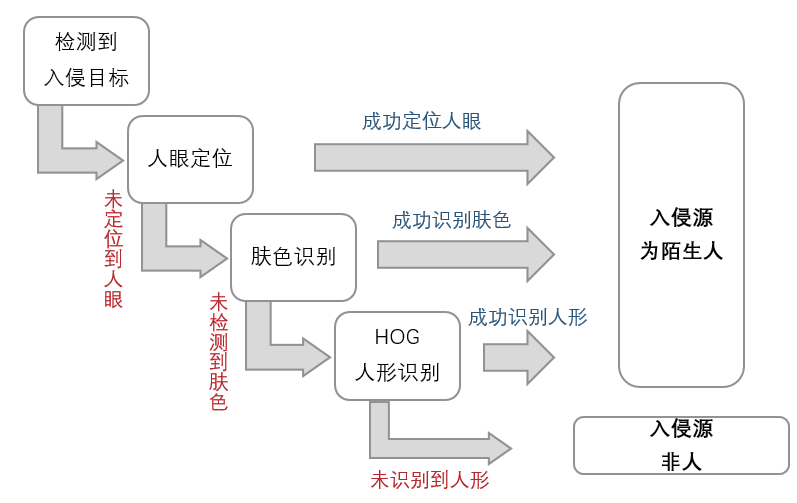

4.2 人与动物区分效果

本设计中对人和动物的区分部分采用了多重模块同时作用,从而保证判断结果更加准确。另外,口罩颜色识别模块还能确定人脸的口罩佩戴规范情况。因此,本设计中多重确认的模块共同发挥作用,使得人和动物的识别判断更加准确和可靠( 如图5)。

图5 人与动物区分逻辑图

4.3 调试最终效果

系统具有两种运行状态: 正常监控状态和入侵报警监控状态。正常监控状态下不对监控视频进行存储和编码传输,入侵报警监控状态下具有触发相应的报警装置并记录监控视频和向上一级监控中心编码传输监控视频的功能。

4.3.1 LED灯光显示--动态目标显示

当采集得的图像数据中检测到移动物体时,本设计中红色LED 灯亮起,提示侦测目标的出现。当上位机控制云台监控电机向左转动时,蓝色LED 灯亮起;向右转动时,绿色LED 灯亮起。

4.3.2 云台转动跟踪--目标追踪

本设计经调试可实现智能跟踪、自动跟拍移动目标的功能,通过控制Pmod Step 板驱动步进电机,带动摄像头延长板底座随之转动,从而实现摄像头的自动转动跟踪功能。

4.3.3 上位机接收信号并反馈--警报信息传送

当采集得的图像数据中被检测有移动物体且对象为人时,WiFi 模块发送警报信息传递至上位机,引起监测方的注意。

5 结语

作为微电子专业的大二学生,在参加这次全国大学生集成电路创新创业大赛中,除了专业能力的锻炼,眼界视角的开阔外,给我们最大的影响其实是思想层面。

比赛中,偶然听得指导教师“AI 已死”,“软件定义芯片”的观点,深感震撼,并对未来智能化的发展心驰神往。

我知道Robei公司不仅仅是一家EDA 公司,也是一家芯片设计公司,我也知道了,本次赛题电路可重构,设备可重构,它真正的名字叫做“可重构机器人”,是真正的未来机器人竞赛。我还知道,在华为被美国绞杀的今天,我们需要这样的工具,而这样的工具也需要我们去支持完善。

参考文献:

[1] 图像二值化[R/OL].https://baike.baidu.com/item/图像二值化/1748870?fr=aladdin.

[2] SiFive,Inc.SiFive Freedom E310 ArtyFPGADev Kit Getting Started Guide[Z].2017:5-12.

[3] 数字集成电路设计描述与仿真[EB/OL].https://m.book118.com/html/2017/0726/124465246.shtm?from=mip.

[4] MARGOLIS M.Arduino权威指南[M].杨昆云,译.2版.北京:人民邮电出版社,2015.

(本文来源于《电子产品世界》杂志2021年3月期)

评论