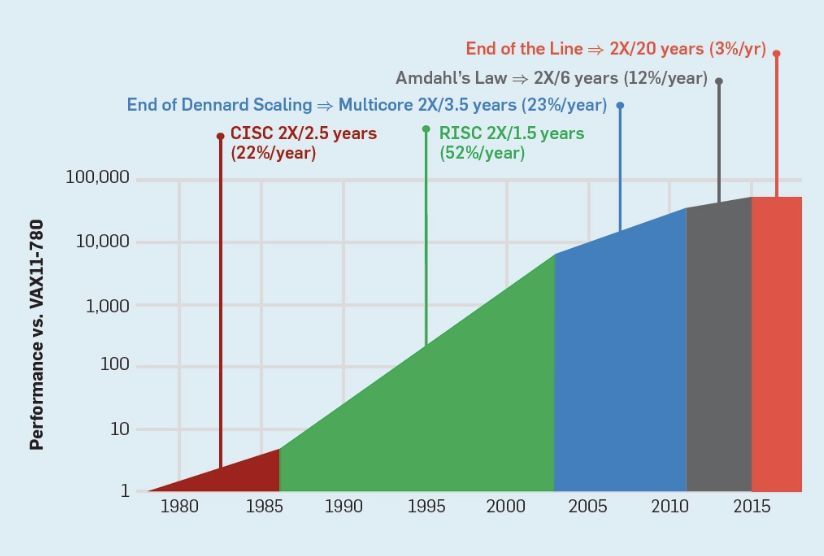

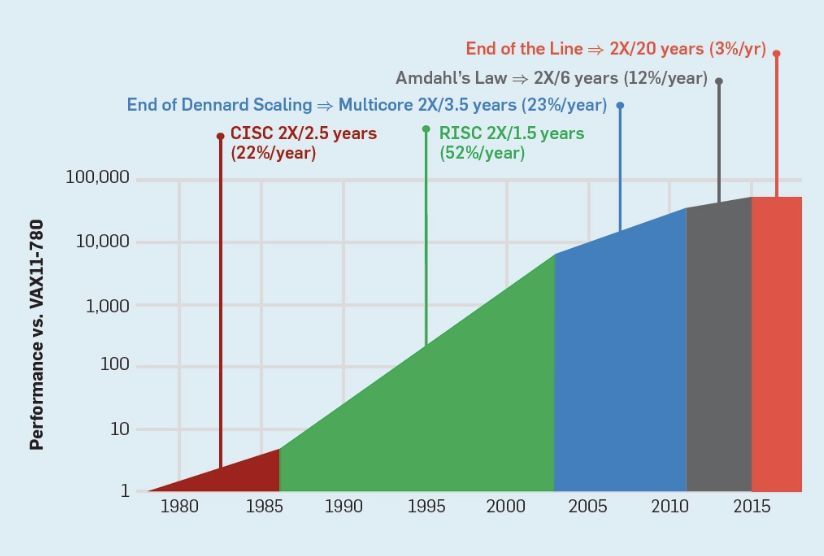

- 摩尔定律的终结将使特定领域的架构成为计算的未来。一个开创性的例子就是谷歌 2015 年推出的张量处理单元(TPU),目前已经在为超过十亿人提供服务。TPU 使深度神经网络(DNN)的计算速度提高了 15-30 倍,能耗效率比现有类似技术的 CPU 和 GPU 提高了 30-80 倍。 本文要点 虽然 TPU 是一种专用集成电路,但它适用于神经网络框架 TensorFlow 下的大量程序,驱动了谷歌数据中心的许多重要应用,包括图像识别、翻译、搜索和游戏。通过专门为神经网络重新分配芯片计算资源,TPU

- 关键字:通用芯片,神经专用架构

神经专用架构介绍

您好,目前还没有人创建词条神经专用架构!

欢迎您创建该词条,阐述对神经专用架构的理解,并与今后在此搜索神经专用架构的朋友们分享。

创建词条

关于我们-

广告服务-

企业会员服务-

网站地图-

联系我们-

征稿-

友情链接-

手机EEPW

Copyright ©2000-2015 ELECTRONIC ENGINEERING & PRODUCT WORLD. All rights reserved.

《电子产品世界》杂志社 版权所有 北京东晓国际技术信息咨询有限公司

京ICP备12027778号-2 北京市公安局备案:1101082052 京公网安备11010802012473